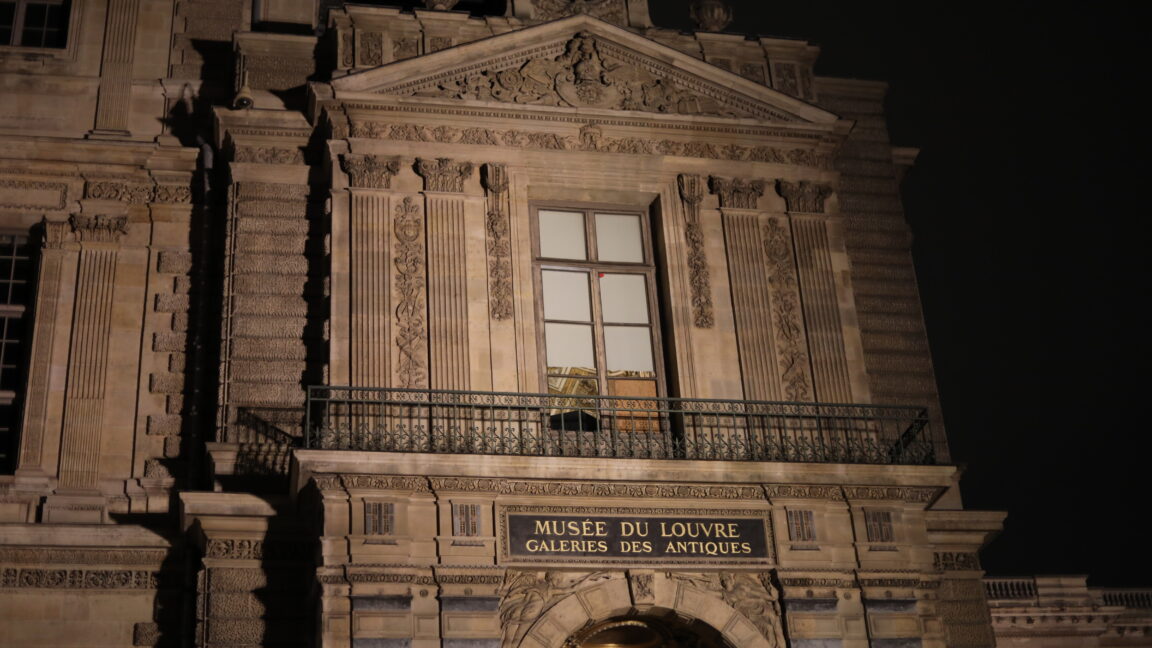

Πώς οι κλέφτες του Λούβρου εκμεταλλεύτηκαν την ανθρώπινη ψυχολογία για να αποφύγουν την υποψία – και τι αποκαλύπτει για την τεχνητή νοημοσύνη

Ένα ηλιόλουστο πρωινό στις 19 Οκτωβρίου 2025, τέσσερις άνδρες φέρεται να μπήκαν στο μουσείο με τις περισσότερες επισκέψεις στον κόσμο και έφυγαν, λίγα λεπτά αργότερα, με κοσμήματα στέμματος αξίας 88 εκατομμυρίων ευρώ (101 εκατομμύρια δολάρια). Η κλοπή από το Μουσείο του Λούβρου του Παρισιού —ένα από τα πιο επιτηρούμενα πολιτιστικά ιδρύματα στον κόσμο— διήρκεσε κάτι λιγότερο από οκτώ λεπτά. Οι επισκέπτες συνέχισαν να περιηγούνται. Η ασφάλεια δεν αντέδρασε (μέχρι να ενεργοποιηθούν οι συναγερμοί). Οι άντρες εξαφανίστηκαν στην κυκλοφορία της πόλης πριν κάποιος καταλάβει τι είχε συμβεί. Οι ερευνητές αποκάλυψαν αργότερα ότι οι κλέφτες φορούσαν γιλέκα hi-vis, μεταμφιεσμένοι σε εργάτες κατασκευών. Έφτασαν με έναν ανελκυστήρα επίπλων, συνηθισμένο θέαμα στα στενά δρομάκια του Παρισιού, και τον χρησιμοποίησαν για να φτάσουν σε ένα μπαλκόνι με θέα στον Σηκουάνα. Ντυμένοι εργάτες, έμοιαζαν σαν να ανήκουν. Αυτή η στρατηγική λειτούργησε γιατί δεν βλέπουμε τον κόσμο αντικειμενικά. Το βλέπουμε μέσα από κατηγορίες—μέσα από αυτό που περιμένουμε να δούμε. Οι κλέφτες κατάλαβαν τις κοινωνικές κατηγορίες που αντιλαμβανόμαστε ως «φυσιολογικές» και τις εκμεταλλεύτηκαν για να αποφύγουν την υποψία. Πολλά συστήματα τεχνητής νοημοσύνης (AI) λειτουργούν με τον ίδιο τρόπο και ως αποτέλεσμα είναι ευάλωτα στα ίδια είδη λαθών. Ο κοινωνιολόγος Erving Goffman θα περιέγραφε τι συνέβη στο Λούβρο χρησιμοποιώντας την αντίληψή του για την παρουσίαση του εαυτού: οι άνθρωποι «εκτελούν» κοινωνικούς ρόλους υιοθετώντας τα σημάδια που περιμένουν οι άλλοι. Εδώ, η απόδοση της κανονικότητας έγινε το τέλειο καμουφλάζ. Η κοινωνιολογία της όρασης Οι άνθρωποι πραγματοποιούν διανοητική κατηγοριοποίηση όλη την ώρα για να κατανοήσουν τους ανθρώπους και τους τόπους. Όταν κάτι ταιριάζει στην κατηγορία του «συνηθισμένου», ξεφεύγει από την προσοχή. Τα συστήματα AI που χρησιμοποιούνται για εργασίες όπως η αναγνώριση προσώπου και ο εντοπισμός ύποπτης δραστηριότητας σε δημόσιο χώρο λειτουργούν με παρόμοιο τρόπο. Για τους ανθρώπους, η κατηγοριοποίηση είναι πολιτισμική. Για την τεχνητή νοημοσύνη, είναι μαθηματικό. Αλλά και τα δύο συστήματα βασίζονται σε μαθησιακά πρότυπα παρά στην αντικειμενική πραγματικότητα. Επειδή η τεχνητή νοημοσύνη μαθαίνει από δεδομένα σχετικά με το ποιος φαίνεται «κανονικός» και ποιος «ύποπτος», απορροφά τις κατηγορίες που είναι ενσωματωμένες στα δεδομένα εκπαίδευσης. Και αυτό το καθιστά επιρρεπές σε μεροληψία. Οι ληστές του Λούβρου δεν θεωρήθηκαν επικίνδυνοι επειδή ταιριάζουν σε μια αξιόπιστη κατηγορία. Στην τεχνητή νοημοσύνη, η ίδια διαδικασία μπορεί να έχει το αντίθετο αποτέλεσμα: οι άνθρωποι που δεν ταιριάζουν με τον στατιστικό κανόνα γίνονται πιο ορατοί και ελέγχονται υπερβολικά. Μπορεί να σημαίνει ότι ένα σύστημα αναγνώρισης προσώπου επισημαίνει δυσανάλογα ορισμένες φυλετικές ή φυλετικές ομάδες ως πιθανές απειλές, ενώ αφήνει άλλους να περάσουν απαρατήρητοι. Ένας κοινωνιολογικός φακός μας βοηθά να δούμε ότι αυτά δεν είναι ξεχωριστά ζητήματα. Το AI δεν εφευρίσκει τις κατηγορίες του. μαθαίνει το δικό μας. Όταν ένα σύστημα όρασης υπολογιστή εκπαιδεύεται σε πλάνα ασφαλείας όπου το «φυσιολογικό» ορίζεται από συγκεκριμένα σώματα, ρούχα ή συμπεριφορά, αναπαράγει αυτές τις υποθέσεις. Ακριβώς όπως οι φύλακες του μουσείου προσπέρασαν τους κλέφτες επειδή φαινόταν ότι ανήκουν, η τεχνητή νοημοσύνη μπορεί να κοιτάξει πέρα από ορισμένα πρότυπα ενώ αντιδρά υπερβολικά σε άλλα. Η κατηγοριοποίηση, είτε ανθρώπινη είτε αλγοριθμική, είναι δίκοπο μαχαίρι. Μας βοηθά να επεξεργαζόμαστε γρήγορα τις πληροφορίες, αλλά επίσης κωδικοποιεί τις πολιτισμικές μας υποθέσεις. Τόσο οι άνθρωποι όσο και οι μηχανές βασίζονται στην αναγνώριση προτύπων, η οποία είναι μια αποτελεσματική αλλά ατελής στρατηγική. Μια κοινωνιολογική άποψη της τεχνητής νοημοσύνης αντιμετωπίζει τους αλγόριθμους ως καθρέφτες: Αντικατοπτρίζουν τις κοινωνικές μας κατηγορίες και ιεραρχίες. Στην υπόθεση του Λούβρου, ο καθρέφτης είναι στραμμένος προς το μέρος μας. Οι ληστές τα κατάφεραν όχι επειδή ήταν αόρατοι, αλλά επειδή φάνηκαν μέσα από το πρίσμα της κανονικότητας. Σε όρους τεχνητής νοημοσύνης, πέρασαν το τεστ ταξινόμησης. Από τις αίθουσες των μουσείων στη μηχανική μάθηση Αυτή η σύνδεση μεταξύ αντίληψης και κατηγοριοποίησης αποκαλύπτει κάτι σημαντικό για τον όλο και πιο αλγοριθμικό κόσμο μας. Είτε είναι ένας φύλακας που αποφασίζει ποιος φαίνεται ύποπτος είτε ένας τεχνητής νοημοσύνης που αποφασίζει ποιος μοιάζει με «κλέφτη καταστημάτων», η υποκείμενη διαδικασία είναι η ίδια: η ανάθεση ατόμων σε κατηγορίες με βάση ενδείξεις που αισθάνονται αντικειμενικοί αλλά είναι πολιτισμικά μαθημένοι. Όταν ένα σύστημα τεχνητής νοημοσύνης περιγράφεται ως «προκατειλημμένο», αυτό συχνά σημαίνει ότι αντικατοπτρίζει αυτές τις κοινωνικές κατηγορίες πολύ πιστά. Η ληστεία του Λούβρου μάς υπενθυμίζει ότι αυτές οι κατηγορίες δεν διαμορφώνουν απλώς τις στάσεις μας, αλλά διαμορφώνουν αυτό που γίνεται αντιληπτό. Μετά την κλοπή, ο υπουργός Πολιτισμού της Γαλλίας υποσχέθηκε νέες κάμερες και αυστηρότερα μέτρα ασφαλείας. Αλλά ανεξάρτητα από το πόσο προηγμένα γίνονται αυτά τα συστήματα, θα εξακολουθούν να βασίζονται στην κατηγοριοποίηση. Κάποιος, ή κάτι, πρέπει να αποφασίσει τι θεωρείται «ύποπτη συμπεριφορά». Εάν αυτή η απόφαση βασίζεται σε υποθέσεις, τα ίδια τυφλά σημεία θα παραμείνουν. Η ληστεία του Λούβρου θα μείνει στη μνήμη μας ως μια από τις πιο θεαματικές κλοπές μουσείων στην Ευρώπη. Οι κλέφτες πέτυχαν γιατί κατέκτησαν την κοινωνιολογία της εμφάνισης: Καταλάβαιναν τις κατηγορίες της κανονικότητας και τις χρησιμοποιούσαν ως εργαλεία. Και με αυτόν τον τρόπο, έδειξαν πώς τόσο οι άνθρωποι όσο και οι μηχανές μπορούν να μπερδέψουν τη συμμόρφωση με την ασφάλεια. Η επιτυχία τους στο φως της ημέρας δεν ήταν μόνο ένας θρίαμβος σχεδιασμού. Ήταν ένας θρίαμβος της κατηγορηματικής σκέψης, της ίδιας λογικής που βασίζεται τόσο στην ανθρώπινη αντίληψη όσο και στην τεχνητή νοημοσύνη. Το μάθημα είναι ξεκάθαρο: Προτού διδάξουμε στις μηχανές να βλέπουν καλύτερα, πρέπει πρώτα να μάθουμε να αμφισβητούμε το πώς βλέπουμε. Vincent Charles, αναγνώστης στο AI για Επιχειρήσεις και Επιστήμη Διοίκησης, Queen’s University Belfast και Tatiana Gherman, Αναπληρώτρια Καθηγήτρια AI για Επιχειρήσεις και Στρατηγική, Πανεπιστήμιο του Northampton. Αυτό το άρθρο αναδημοσιεύεται από το The Conversation με άδεια Creative Commons. Διαβάστε το αρχικό άρθρο.

Δημοσιεύτηκε: 2025-11-19 14:41:00

πηγή: arstechnica.com